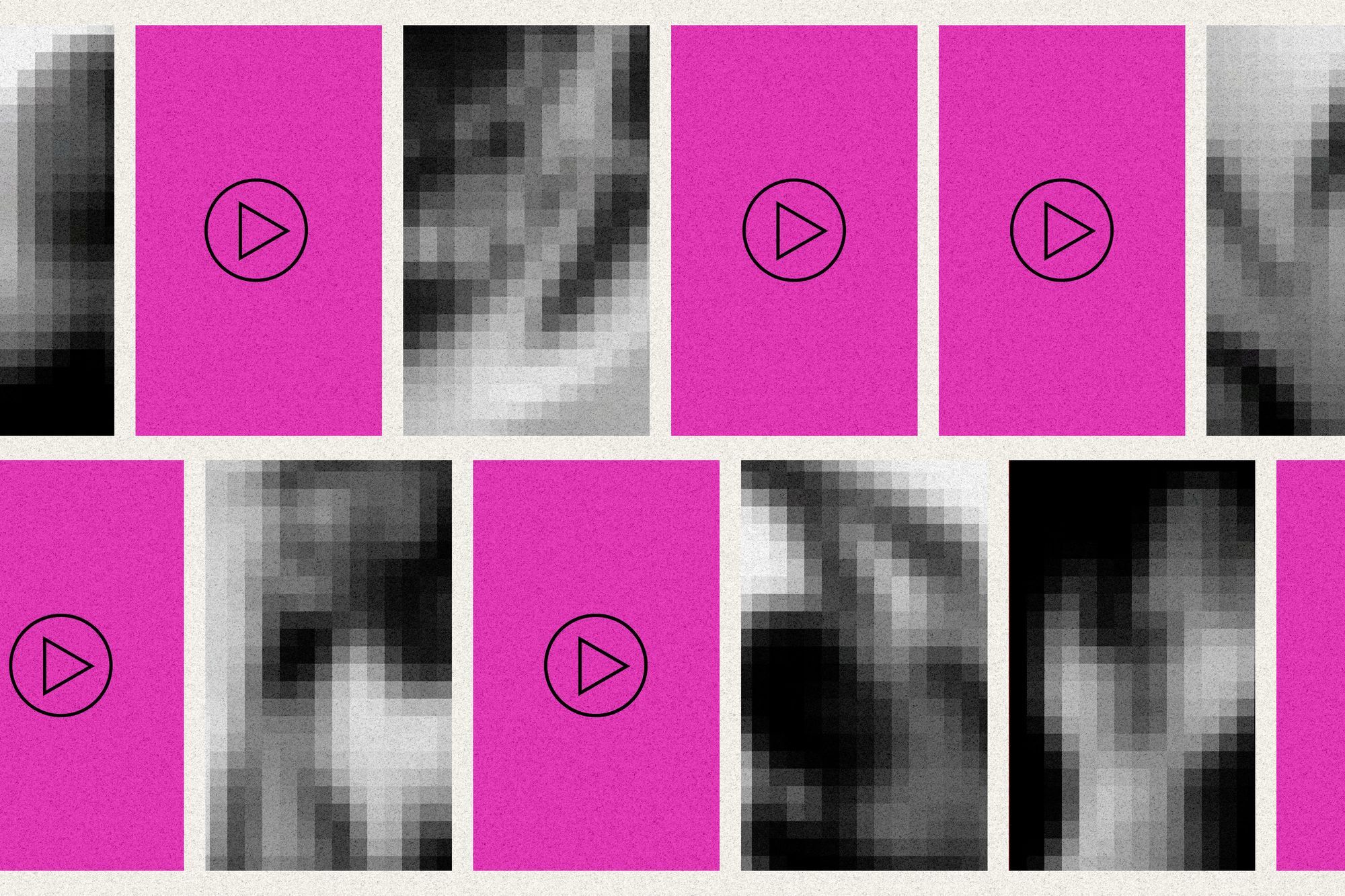

Shërbimi i videove Reels i Instagram-it është krijuar për t’u shfaqur përdoruesve transmetime videosh të shkurtra për tema që sistemi vendos se do t’i interesojnë, të tilla si sporti, moda ose humori.

Aplikacioni social tregon të njëjtën gjë për përdoruesit që algoritmi i tij vendos se mund të ketë një interes të madh për fëmijët, tregoi testimi nga The Wall Street Journal.

Gazeta u përpoq të përcaktonte se çfarë do t’i rekomandonte algoritmi Reels i Instagram-it për testimin e llogarive të krijuara për të ndjekur vetëm gjimnastët e rinj, nxitësit e tifozëve dhe influencuesit e tjerë adoleshentë dhe paraadoleshentë aktivë në platformë.

Sistemi i Instagram-it u shërbeu atyre llogarive testuese doza të turbullta të përmbajtjes së keqe, duke përfshirë pamjet e rrezikshme të fëmijëve, si dhe videot e hapura seksuale për të rritur dhe reklama për disa nga markat më të mëdha amerikane.

Gazeta krijoi llogaritë e testimit pasi vëzhgoi se mijëra ndjekës të llogarive të të rinjve të tillë shpesh përfshijnë një numër të madh burrash të rritur dhe se shumë nga llogaritë që i ndiqnin ata fëmijë gjithashtu kishin treguar interes për përmbajtjen e seksit që lidhej me fëmijët dhe të rriturit. Gazeta testoi gjithashtu se çfarë do rekomandonte algoritmi pasi llogaritë e tij ndoqën disa nga ata përdorues gjithashtu, të cilët prodhonin përmbajtje më shqetësuese të ndërthurura me reklama.

Në një rrymë videosh të rekomanduara nga Instagram, një reklamë për aplikacionin e takimeve “Bumble” u shfaq midis një videoje të dikujt që përkëdhel fytyrën e një kukulle latex në madhësi reale të një njeriu dhe një videoje të një vajze të re me një fytyrë të errësuar në mënyrë dixhitale duke ngritur këmishën e saj për ta ekspozuar mesin e saj. Në një tjetër, një reklamë e “Pizza Hut” ndoqi një video të një burri të shtrirë në një shtrat me krahun e tij rreth asaj që mbishkrimi thoshte se ishte një vajzë 10-vjeçare.

Qendra Kanadeze për Mbrojtjen e Fëmijëve, një grup për mbrojtjen e fëmijëve, kreu teste të ngjashme më vete, me rezultate të ngjashme.

Meta tha se testet e WSJ prodhuan një përvojë të prodhuar që nuk përfaqëson atë që shohin miliarda përdorues. Kompania nuk pranoi të komentonte pse algoritmet përpiluan transmetime videosh të veçanta që shfaqnin fëmijë, seks dhe reklama, por një zëdhënës tha se në tetor ajo prezantoi mjete të reja sigurie të markave që u japin reklamuesve kontroll më të madh se ku shfaqen reklamat e tyre dhe se Instagrami ose heq ose zvogëlon rëndësinë e katër milionë videove të dyshuara për shkelje të standardeve të saj çdo muaj.

Gazeta raportoi në qershor se algoritmet e drejtuara nga Meta, e cila zotëron Facebook dhe Instagram, lidhin komunitete të mëdha të përdoruesve të interesuar për përmbajtjen pedofilike. Zëdhënësi i Meta tha se një grup pune i ngritur pas shkrimit të WSJ ka zgjeruar sistemet e tij të automatizuara për zbulimin e përdoruesve që sillen në mënyrë të dyshimtë, duke hequr dhjetëra mijëra llogari të tilla çdo muaj. Kompania gjithashtu po merr pjesë në një koalicion të ri të industrisë për të ndarë sinjalet e shfrytëzimit të mundshëm të fëmijëve.

Kompanitë, reklamat e të cilave u shfaqën krahas përmbajtjes së papërshtatshme në testet e WSJ përfshijnë Disney, Walmart, kompaninë e takimeve në internet Match Group, Hims, e cila shet ilaçe për mosfunksionimin e ereksionit dhe vetë Wall Street Journal. Shumica e shitësve me pakicë me emra të markave kërkojnë që reklamat e tyre të mos shfaqen pranë përmbajtjes seksuale ose eksplicite.

“Sistemet tona janë efektive në pakësimin e përmbajtjes së dëmshme dhe ne kemi investuar miliarda në sigurinë dhe zgjidhjet e përshtatshmërisë së markës,” tha Samantha Stetson, një nënkryetare e Meta që merret me marrëdhëniet me industrinë e reklamave. Ajo tha se prevalenca e përmbajtjes së papërshtatshme në Instagram është e ulët dhe se kompania investon shumë në pakësimin e saj.

Pasi WSJ kontaktoi kompanitë, reklamat e të cilave u shfaqën në testim pranë videove të papërshtatshme, disa thanë se Meta u tha atyre se po hetonte dhe do paguante për auditimet e sigurisë së markës nga një firmë e jashtme.

Pas asaj që e përshkroi si përgjigje të pakënaqshme të Meta-s ndaj ankesave të saj, Match filloi të anulonte reklamat e Meta-s për disa prej aplikacioneve të saj, si Tinder, në tetor. Që atëherë, ajo ka ndaluar të gjitha reklamat e Reels dhe ka ndaluar promovimin e markave të saj kryesore në ndonjë nga platformat e Meta-s.

“Ne nuk kemi dëshirë të paguajmë Meta për të tregtuar markat tona te grabitqarët ose të vendosim reklamat tona kudo afër kësaj përmbajtjeje të keqe,” tha zëdhënësja e Match, Justine Saço.

Robbie McKay, një zëdhënës i Bumble, tha se “kurrë nuk do reklamonte qëllimisht përmbajtje të papërshtatshme” dhe se kompania po pezullon reklamat e saj nëpër platformat e Meta-s.

Charlie Cain, zëvendëspresident i Disney për menaxhimin e markës, tha se kompania ka vendosur kufizime të rrepta për përmbajtjen e mediave sociale të pranueshme për reklamim dhe ka shtyrë Meta-n dhe platforma të tjera për të përmirësuar veçoritë e sigurisë së markës. Një zëdhënëse e kompanisë tha se që kur WSJ prezantoi gjetjet e saj te Disney, kompania kishte punuar për të adresuar çështjen në “nivelet më të larta në Meta”.

Walmart nuk pranoi të komentonte dhe Pizza Hut nuk iu përgjigj kërkesave për koment.

Hims tha se do ushtronte presion ndaj Meta-s për të parandaluar një vendosje të tillë reklamash dhe se e konsideronte premtimin e Meta-s për të punuar mbi problemin, shpresëdhënës.

WSJ tha se ishte e alarmuar që reklama e saj u shfaq pranë një videoje të një akti seksual dhe se do kërkonte veprim nga Meta.

Meta krijoi Reels për të konkurruar me TikTok, platformën e ndarjes së videove në pronësi të ByteDance me bazë në Pekin. Të dy produktet ushqejnë përdoruesit me një sërë videosh të postuara nga të tjerët dhe fitojnë para duke futur reklama mes tyre. Algoritmet e të dy kompanive i tregojnë një përdoruesi videot që platformat llogaritin ka shumë të ngjarë ta mbajnë atë përdorues të angazhuar, bazuar në sjelljen e tij/saj të shikimit në të kaluarën.

Gazetarët e WSJ krijuan llogaritë e testimit në Instagram si të rritur në pajisjet e blera rishtazi dhe ndoqën gjimnastët, nxitësit e tifozëve dhe influencuesit e tjerë të rinj. Testet treguan se ndjekja vetëm e vajzave të reja bëri që Instagram të fillonte të servirte video nga llogaritë që promovonin përmbajtje seksi për të rritur, së bashku me reklamat për markat kryesore të konsumatorit, të tilla si ajo për Walmart që u shfaq pas një videoje të një gruaje që ekspozonte pjesën e turpshme.

Kur llogaritë e testimit ndoqën më pas disa përdorues që ndoqën llogaritë e po atyre të rinjve, ata dhanë rekomandime edhe më shqetësuese. Platforma shërbeu një përzierje të pornografisë së të rriturve dhe materialeve seksuale për fëmijë, të tilla si një video e një vajze të veshur që përkëdhel bustin e saj dhe një tjetër e një fëmije që bën pantomim për një akt seksual.

Përzierje shqetësuese

Përzierje shqetësuese

Në testet e Wall Street Journal, shërbimi Reels i Instagram shpërndau video të shkurtra që shfaqnin pamje të rrezikshme të fëmijëve, video të hapura seksuale për të rritur dhe reklama nga markat e mëdha.

Ekspertët e sistemeve të rekomandimeve algoritmike thanë se testet e WSJ treguan se ndërsa gjimnastika mund të duket si një temë e padëmshme, ndjekja e sjelljes së Metës ka dalluar se disa përdorues të Instagramit që ndjekin vajzat para adoleshente do duan të përfshihen me video që seksualizojnë fëmijët dhe më pas t’i drejtojnë përmbajtje të tilla drejt tyre.

“Përmbajtja e specializuar ofron një sinjal shumë më të fortë sesa përmbajtja e interesit të përgjithshëm,” tha Jonathan Stray, shkencëtar i lartë për Qendrën për Inteligjencën Artificiale të Përputhshme në Universitetin e Kalifornisë, Berkeley.

Punonjësit aktualë dhe ish-punonjësit e Meta-s thanë në intervista se tendenca e algoritmeve të Instagramit për të grumbulluar përmbajtje të seksualizimit të fëmijëve nga e gjithë platforma e saj dihej nga brenda si një problem. Sapo Instagram zbulon një përdorues të interesuar për ndonjë temë të veçantë, thanë ata, sistemet e tij të rekomandimeve janë stërvitur për të nxitur më shumë përmbajtje të lidhura me ta.

Parandalimi i sistemit që të shtyjë përmbajtje të dëmshme për përdoruesit e interesuar për të, thanë ata, kërkon ndryshime të rëndësishme në algoritmet e rekomandimit që gjithashtu nxisin angazhimin për përdoruesit normalë.

Dokumentet e kompanisë të shqyrtuara nga WSJ tregojnë se punonjësit e sigurisë së kompanisë janë të ndaluar gjerësisht të bëjnë ndryshime në platformë që mund të zvogëlojnë përdoruesit aktivë të përditshëm me çdo sasi të matshme.

Llogaritë e testimit treguan se reklamat shtoheshin rregullisht në transmetimet problematike të Reels. Reklamat që nxisnin përdoruesit të vizitonin Disneyland-in për pushime u shfaqën pranë një videoje të një të rrituri duke bërë seks dhe një tjetër të një gruaje të re me të brendshme me gjak të rremë që i rrjedh nga goja.

Një reklamë për Hims u shfaq menjëherë pas një videoje që përshkruante një grua në dukje të shqetësuar në një situatë seksuale së bashku me një lidhje me atë që përshkruhej si “videoja e plotë”.

Edhe përpara nisjes së Reels në 2020, punonjësit e Meta e kuptuan se prodhimi paraqiste shqetësime sigurie, sipas ish-punonjësve.

Një pjesë e problemit është se sistemet e automatizuara të zbatimit e kanë më të vështirë analizimin e përmbajtjes së videos sesa tekstin ose pamjet statike. Një tjetër vështirësi lind nga mënyra se si funksionon Reels: Në vend që të tregojë përmbajtje të ndarë nga miqtë e përdoruesve, siç bëjnë shpesh pjesët e tjera të Instagram dhe Facebook, Reels promovon video nga burime që ata nuk i ndjekin.

Në një analizë të bërë pak para prezantimit të Reels, stafi i sigurisë së Meta-s vuri në dukje rrezikun që produkti të lidhte video me fëmijë dhe përmbajtje të papërshtatshme, sipas dy ish-punonjësve. Vaishnavi J, ish-kreu i politikave rinore të Meta-s, e përshkroi rekomandimin e rishikimit të sigurisë si: “Ose do rrisim aftësitë tona të zbulimit të përmbajtjes, ose nuk rekomandojmë ndonjë përmbajtje me minorenë “, që do të thotë ndonjë video me fëmijë.

Në atë kohë, TikTok po rritej me shpejtësi, duke tërhequr vëmendjen e përdoruesve të rinj të Instagramit dhe reklamuesve që i synonin ata. Meta nuk miratoi asnjë nga rekomandimet e analizës së sigurisë në atë kohë, sipas Vaishnavi J.

Stetson, ndërlidhësi i Meta-s me blerësit e reklamave dixhitale, kundërshtoi se Meta kishte anashkaluar shqetësimet për sigurinë e fëmijëve përpara hedhjes në treg të produktit.

“Ne testuam Reels për gati një vit përpara se ta lëshonim gjerësisht, me një grup të fuqishëm kontrollesh dhe masash sigurie,” tha ajo.

Platformat e ndarjes së videove u bëjnë thirrje kompanive të mediave sociale, sepse videot priren të mbajnë vëmendjen e përdoruesve më gjatë se teksti ose fotot, duke i bërë ato tërheqëse për reklamuesit.

Pasi fillimisht u përpoq për të maksimizuar potencialin e të ardhurave të produktit të saj Reels, Meta ka përmirësuar mënyrën se si algoritmet e saj rekomandojnë përmbajtjen dhe personalizojnë transmetimet video për përdoruesit.

Platformat e mediave sociale dhe agjencitë e reklamave dixhitale shpesh i përshkruajnë vendosjet e papërshtatshme të reklamave si gabime fatkeqe. Por llogaritë e testimit të drejtuara nga WSJ dhe Qendra Kanadeze për Mbrojtjen e Fëmijëve sugjerojnë se platformat e Meta-s duket se synojnë disa përdorues të interesuar për seksin.

Ndër reklamat që shfaqeshin rregullisht në llogaritë e testit të WSJ ishin ato për aplikacionet e “takimeve” dhe platformat e transmetimit të drejtpërdrejtë që shfaqnin lakuriqësi të të rriturve, sallone masazhi që ofrojnë “marrëdhënie seksuale” dhe chatbot me inteligjencë artificiale të ndërtuara për seksin kibernetik. Rregullat e Meta-s supozohet të ndalojnë reklama të tilla.

WSJ e informoi Meta-n në gusht për rezultatet e testimit të saj. Në muajt që nga ajo kohë, testet si nga WSJ ashtu edhe nga Qendra Kanadeze për Mbrojtjen e Fëmijëve tregojnë se platforma vijoi të shfaqte një seri videosh që shfaqnin fëmijë të vegjël, përmbajtje për të rritur dhe promovime të dukshme për materialet seksuale të fëmijëve të organizuara diku tjetër.

Që nga mesi i nëntorit, qendra tha se Instagram po rekomandon në mënyrë të qëndrueshme atë që organizata jofitimprurëse e përshkroi si “të rritur dhe fëmijë që bëjnë pozime seksuale”.

Pasi WSJ filloi të kontaktonte reklamuesit në lidhje me vendosjet dhe ato kompani ngritën pyetje, Meta u tha atyre se po hetonte çështjen dhe do paguante për shërbimet e auditimit të sigurisë së markës për të përcaktuar se sa shpesh shfaqen reklamat e një kompanie pranë përmbajtjes që ajo e konsideron të papranueshme.

Meta nuk ka ofruar një afat kohor për zgjidhjen e problemit ose nuk ka shpjeguar se si në të ardhmen do të kufizonte promovimin e përmbajtjeve të papërshtatshme me fëmijë.

Llogaritë e testimit të WSJ zbuluan se problemi madje preku markat e lidhura me Meta. Reklamat për shërbimin e enkriptuar të bisedës WhatsApp të kompanisë dhe syzet Ray-Ban të Story-ve të Meta-s u shfaqën pranë pornografisë për të rritur.

Një reklamë për Lean In Girls, organizatën jofitimprurëse për fuqizimin e grave të reja e drejtuar nga ish-shefi operative e Meta-s, Sheryl Sandberg, u shfaq drejtpërdrejt përpara një promovimi për një krijues të përmbajtjes seksuale për të rritur, i cili shpesh shfaqet me veshje nxënëseje. Sandberg nuk pranoi të komentojë.

Nëpërmjet testeve të veta, Qendra Kanadeze për Mbrojtjen e Fëmijëve arriti në përfundimin se Instagram po shërbente rregullisht video dhe fotografi të fëmijëve të veshur, të cilët shfaqen gjithashtu në bazën e të dhënave dixhitale të Qendrës Kombëtare për Fëmijët e Zhdukur dhe të Shfrytëzuar të imazheve dhe videove të konfirmuara se ishin materiale seksuale të abuzimit me fëmijët. Grupi tha se abuzuesit e fëmijëve shpesh përdorin imazhet e vajzave për të reklamuar përmbajtje të paligjshme për shitje në forumet e internetit.

Natyra e përmbajtjes – seksualizimi i fëmijëve pa shfaqur përgjithësisht lakuriqësi – pasqyron mënyrën se si media sociale ka ndryshuar abuzimin seksual të fëmijëve në internet, tha Lianna McDonald, drejtore ekzekutive për qendrën kanadeze. Grupi ka ngritur shqetësime në lidhje me aftësinë e algoritmeve të Meta-s për të rekrutuar në thelb anëtarë të rinj të komuniteteve online të përkushtuar ndaj abuzimit seksual të fëmijëve, ku lidhjet me përmbajtje të paligjshme në forume më private shtohen.

“Herë pas here, ne kemi parë algoritme rekomandimi që i shtyjnë përdoruesit të zbulojnë dhe më pas të rrotullohen brenda këtyre komuniteteve në internet të shfrytëzimit të fëmijëve,” tha McDonald, duke e quajtur shqetësuese që reklamat nga kompanitë e mëdha po e subvenciononin atë proces.

VINI RE: Ky material është pronësi intelektuale e WSJ