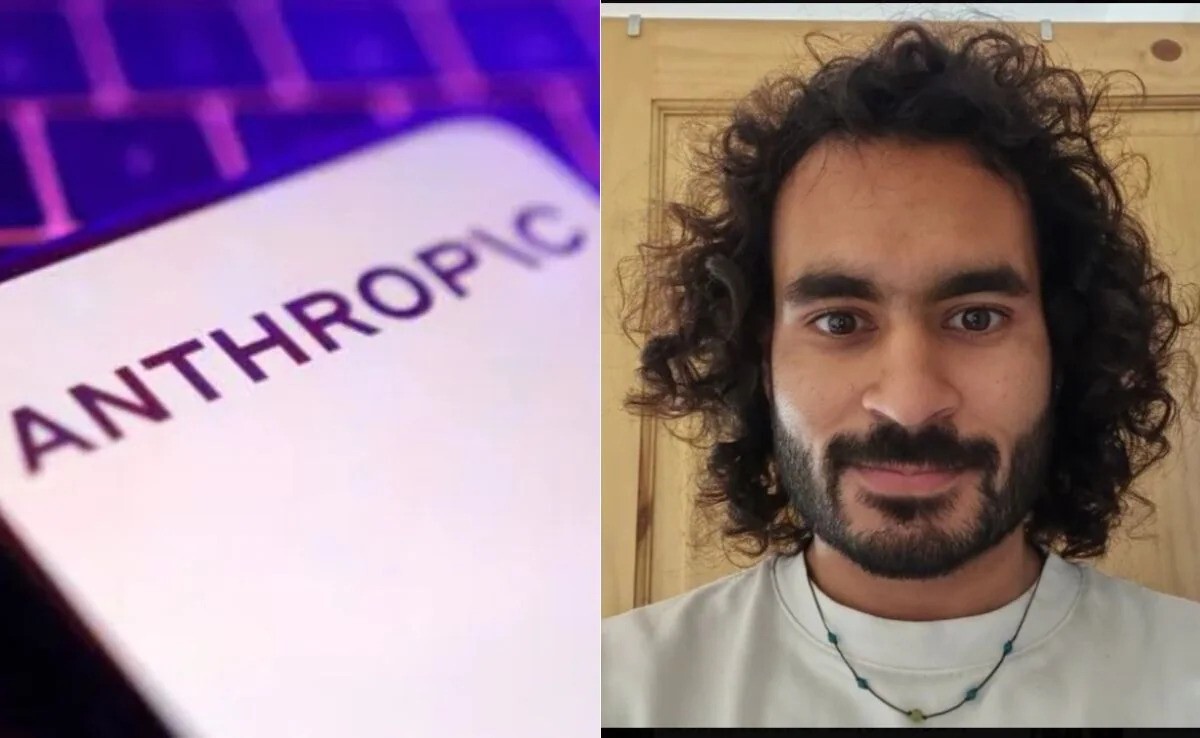

Një nga studiuesit e sigurisë së Inteligjencës Artificiale ka dhënë dorëheqjen nga kompania amerikane , duke e shoqëruar largimin me një paralajmërim të fortë: “Bota është në rrezik”.

Në letrën e tij të publikuar në platformën X, Mrinank Sharma thekson se vendimi për t’u larguar lidhet me shqetësimet për zhvillimet në fushën e IA-së, rreziqet e armëve biologjike dhe krizave të shumta globale që, sipas tij, po ndërthuren në mënyrë alarmante. Ai njoftoi se do t’i përkushtohet shkrimit dhe studimit të poezisë, duke u rikthyer në Mbretërinë e Bashkuar për një periudhë të tërheqjes publike, që e përshkroi si “të bëhem i padukshëm”.

Largimi i tij përkon me dorëheqjen e një tjetër studiuesjeje nga , e cila ngriti pikëpyetje mbi vendimin e kompanisë për të futur reklama në chatbot-in .

Anthropic, e njohur për zhvillimin e chatbot-it dhe e themeluar në vitin 2021 nga ish-punonjës të OpenAI, është pozicionuar si një kompani me theks të veçantë te siguria dhe kontrolli i rreziqeve të IA-së. Sharma drejtonte një ekip që merrej me masa mbrojtëse ndaj sistemeve gjenerative, përfshirë analizën e tendencës së modeleve për të “kënaqur” përdoruesit, rreziqet e bioterrorizmit të asistuar nga IA dhe ndikimin e asistentëve digjitalë në sjelljen njerëzore.

Megjithëse vlerësoi përvojën në kompani, ai nënvizoi se kishte ardhur momenti për të ecur përpara. “Bota është në rrezik. Dhe jo vetëm nga IA apo armët biologjike, por nga një varg krizash të ndërlidhura që po zhvillohen pikërisht tani,” shkroi ai, duke shtuar se edhe organizatat që shpallin vlera të forta përballen me presione të vazhdueshme për t’i zbehur ato.

Anthropic e përkufizon veten si një korporatë për përfitim publik, e përkushtuar ndaj maksimizimit të përfitimeve të IA-së dhe zbutjes së rreziqeve të saj. Megjithatë, kompania është përballur edhe me kritika. Në vitin 2025, ajo pranoi të paguante 1.5 miliardë dollarë për të mbyllur një padi kolektive nga autorë që pretendonin se veprat e tyre ishin përdorur pa leje për trajnimin e modeleve të IA-së, shkruan BBC.